#5 Souveraineté et IA générative : le prochain front

🤖 7 des 10 meilleurs LLM mondiaux sont américains. La souveraineté IA ne se joue pas que dans les modèles — elle se joue dans vos données. 🇫🇷 Mistral reste le seul acteur européen dans le top 10.

Il y a un paradoxe que peu de dirigeants ont encore pleinement mesuré.

Une organisation peut faire tous les efforts du monde pour sécuriser ses données dans un cloud souverain : chiffrement, SecNumCloud, prestataire de droit européen... et voir tous ces efforts réduits à néant par une seule décision : utiliser ChatGPT, Claude ou Gemini pour assister ses équipes au quotidien.

Ce paradoxe n'est pas théorique.

Il se produit chaque jour dans des milliers d'entreprises françaises et européennes, dans des milliers d'échanges entre des collaborateurs et des assistants IA hébergés sur des infrastructures américaines :

- Un avocat qui soumet un dossier confidentiel à GPT-4 pour en tirer un résumé.

- Un ingénieur qui utilise GitHub Copilot pour générer du code sur un projet stratégique.

- Un directeur financier qui demande à un assistant IA d'analyser des données de performance avant une fusion-acquisition.

Dans chacun de ces cas, les données quittent l'organisation, transitent par des serveurs soumis au droit américain, et sont potentiellement utilisées pour améliorer les modèles, à moins que des clauses contractuelles spécifiques ne l'interdisent explicitement.

L'IA générative est devenue, en l'espace de trois ans, la nouvelle chaîne de montage de l'ingénierie logicielle et du travail intellectuel.

Et comme toute chaîne de montage, elle soulève une question fondamentale de dépendance : qui en détient les rouages, et à quelles conditions ?

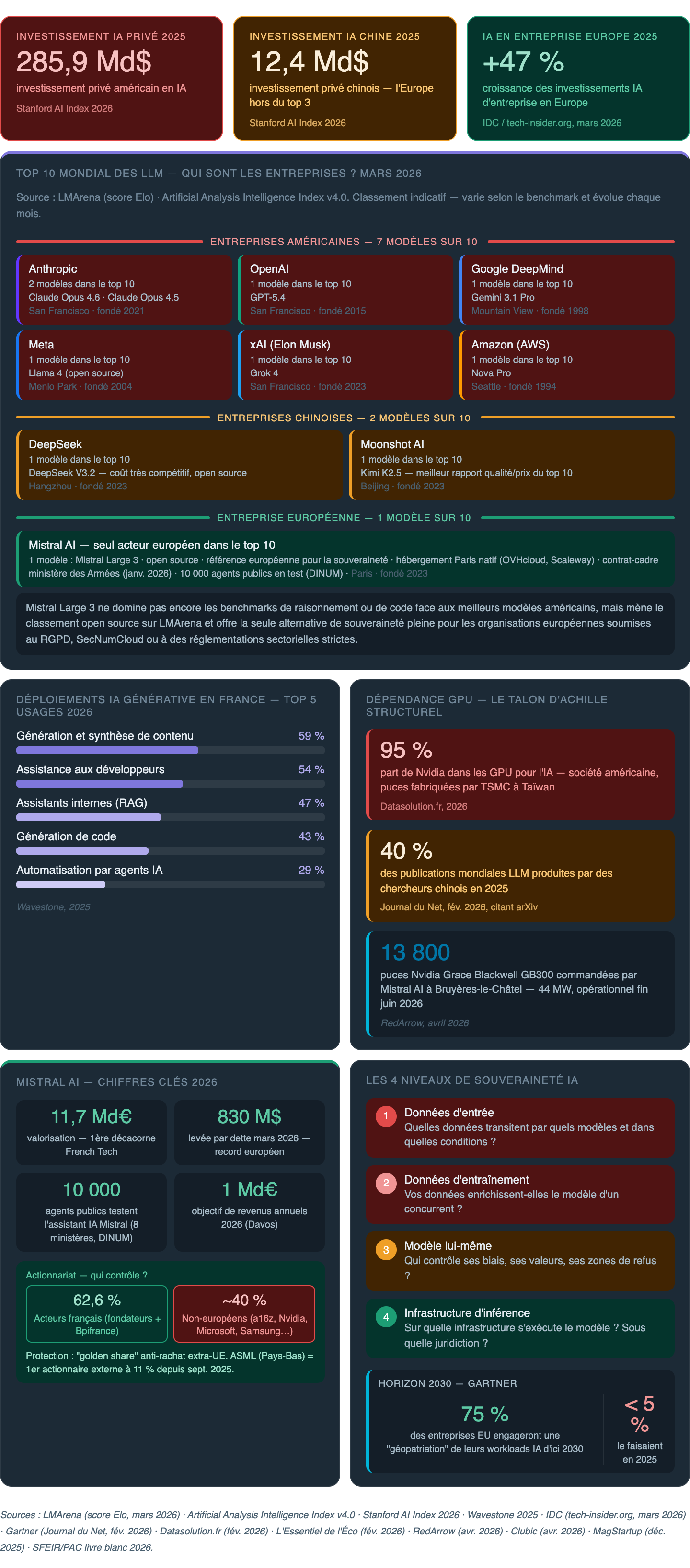

Un marché dominé à 90 % par des acteurs non-européens

Le constat de départ est brutal.

Parmi les neuf entreprises fournissant les modèles de langage les plus performants au monde en ce début d'année 2026, six sont américaines :

- OpenAI,

- Anthropic,

- Google,

- Meta

- xAI

- Amazon/AWS

deux sont chinoises:

- DeepSeek,

- Moonshot AI

et une seule est européenne :

- Mistral AI.

C'est l'état des forces au sommet de la compétition autour de l'IA à l'échelle mondiale.

Ces chiffres racontent une histoire simple : l'Europe a, pour l'instant, perdu la course aux modèles de fondation (LLM).

Elle a perdu parce qu'elle a perdu :

- la course aux investissements : 285 milliards de dollars américains contre une poignée de milliards européens

- la course aux GPU : 95 % sont produits par Nvidia, société américaine, sur des puces fabriquées par TSMC à Taïwan.

Mais cette histoire simple cache une réalité plus nuancée.

La mauvaise question... et la bonne

La mauvaise question est : "L'Europe a-t-elle les meilleurs modèles ?"

La réponse est non, et elle restera probablement non pour les années à venir, compte tenu de l'écart d'investissement.

La bonne question est : "Sur quoi se joue réellement la souveraineté dans l'IA générative ?"

La réponse, formulée par Luxsure en février 2026, est celle-ci : l'Europe ne perd pas l'IA dans les modèles.

Elle la perd :

- dans la commande publique,

- dans l'infrastructure,

- dans les habitudes d'achat et les arbitrages quotidiens

qui conduisent des milliers d'organisations à adopter des outils américains non pas parce qu'ils sont intrinsèquement supérieurs, mais parce qu'ils sont là, disponibles, familiers et intégrés dans les écosystèmes existants.

La souveraineté dans l'IA générative se joue en réalité sur quatre niveaux distincts, qu'il importe de distinguer pour ne pas confondre les problèmes et les solutions.

Les quatre niveaux de la souveraineté IA

Niveau 1 : La souveraineté des données d'entrée.

C'est la question la plus immédiate : quelles données transitent par quels modèles, et dans quelles conditions ?

Lorsqu'un collaborateur soumet un document confidentiel à un service d'IA générative hébergé aux États-Unis, ces données sont potentiellement exposées au CLOUD Act et au FISA 702 — exactement comme n'importe quelle donnée stockée chez un prestataire américain.

La différence est que l'exposition est souvent invisible et non délibérée : personne n'a "décidé" de stocker des données sensibles chez OpenAI, elles y arrivent naturellement au fil des usages quotidiens.

Niveau 2 : La souveraineté des données d'entraînement.

C'est la dimension la moins visible mais potentiellement la plus grave à long terme.

Les modèles d'IA apprennent de leurs données d'entraînement.

Si les conditions générales d'utilisation d'un service permettent l'utilisation des données soumises pour améliorer les modèles — ce qui était le cas par défaut pour de nombreux services avant que la pression réglementaire ne les contraigne à proposer des options d'opt-out* — une organisation peut involontairement contribuer à enrichir un modèle concurrent avec ses propres données propriétaires.

Sa propriété intellectuelle, ses processus, ses formulations techniques deviennent, de fait, une ressource d'entraînement pour un tiers.

*Options d'opt-out : OpenAI Enterprise, Anthropic for Business et Google Vertex AI proposent des garanties contractuelles explicites sur l'utilisation des données.

Par défaut, les services d'IA grand public peuvent utiliser les conversations et les documents soumis par les utilisateurs pour améliorer et ré-entraîner leurs modèles.

Cela signifie concrètement que vos données propriétaires, vos documents internes ou vos échanges professionnels pourraient contribuer à enrichir un modèle que vos concurrents utilisent également.

Les offres enterprise permettent de désactiver ce mécanisme — c'est ce qu'on appelle l'opt-out : une clause contractuelle par laquelle le prestataire s'engage à ne jamais utiliser vos données pour entraîner ses modèles, ni les partager avec des tiers.

Vos données ne servent qu'à vous répondre, puis sont supprimées.

Ces garanties sont réelles sur le plan opérationnel, mais elles ne résolvent pas l'exposition au CLOUD Act et au FISA, comme nous l'avons vu dans les articles précédents de cette série.

Niveau 3 : La souveraineté du modèle lui-même.

C'est la dimension la plus débattue dans les cercles politiques et industriels, parce qu'elle est la plus visible.

Qui développe les modèles de référence ?

Qui contrôle leurs biais, leurs valeurs, leurs zones de refus ?

Un modèle entraîné principalement sur des corpus anglo-américains, par des équipes américaines, avec des valeurs culturelles américaines, produira mécaniquement des biais dans ses réponses sur des sujets politiques, sociaux ou culturels.

Ce n'est pas une conspiration — c'est une propriété fondamentale de l'apprentissage automatique.

Niveau 4 : La souveraineté de l'infrastructure d'inférence.

C'est la dimension que le livre blanc de SFEIR/PAC résume avec la formule suivante : "Investissez dans vos données, pas dans les modèles."

Même en utilisant un modèle open source parfaitement neutre, si l'infrastructure sur laquelle il est exécuté — les GPU, les datacenters, les couches réseau et d'orchestration — est contrôlée par un acteur américain, l'exposition juridique demeure.

La souveraineté se joue finalement moins dans le modèle que dans l'infrastructure d'exécution.

✏️ Le paradoxe Mistral : champion européen, actionnariat mixte

Mistral AI est devenue en moins de trois ans la référence européenne de l'IA générative.

Fondée en 2023 par d'anciens chercheurs de Google DeepMind et de Meta, valorisée à 11,7 milliards d'euros en 2026, elle a décroché un accord-cadre avec le ministère des Armées français en janvier 2026 et pilote depuis octobre 2025 un assistant IA pour 10 000 agents publics français.

Mais Mistral illustre aussi parfaitement la tension irrésolue de la "souveraineté IA" européenne — sur trois dimensions.

La dimension capitalistique.

Les fondateurs français détiennent environ 35,5 % du capital, et les investisseurs seed français (dont Bpifrance) environ 27 % — soit 62,6 % aux mains d'acteurs français au total.

En septembre 2025, ASML — acteur néerlandais stratégique — est devenu le premier actionnaire externe avec 11 % du capital pour 1,3 milliard d'euros.

Mais 40 % du capital appartient à des acteurs non-européens : Andreessen Horowitz, General Catalyst, Lightspeed (fonds américains), Nvidia (américain), DST Global, Samsung, Sanabil (Arabie Saoudite)...

Sans oublier que Microsoft a pris une participation minoritaire lors du partenariat Azure de février 2024.

Le tableau est donc contrasté : majorité française préservée, mais présence étrangère non européenne structurelle et significative.

Une protection existe cependant : Mistral a négocié une "golden share" anti-rachat extra-UE, qui protège contre une acquisition hostile par un acteur non-européen.

Ceci distingue Mistral de nombreuses pépites françaises qui ont fini rachetées par des acteurs californiens.

La dimension distribution.

Le principal vecteur de distribution internationale de Mistral reste son alliance avec Microsoft Azure, qui donne accès à la base clients enterprise d'Azure à l'échelle mondiale.

Distribuer ses modèles via le premier hyperscaler américain tout en se positionnant comme "l'alternative européenne aux géants de la Silicon Valley" est une contradiction que la startup doit continuer de justifier.

La dimension infrastructure.

Mistral entraîne ses modèles sur des GPU Nvidia — société américaine — et a utilisé AWS et Azure pour une partie de ses entraînements, malgré son partenariat avec OVHcloud.

Son datacenter à Bruyères-le-Châtel, financé par 830 millions de dollars de dette en mars 2026, s'équipera de 13 800 puces Nvidia Grace Blackwell — américaines.

La souveraineté est réelle sur le plan du modèle (code ouvert, équipe française, gouvernance française), mais structurellement dépendante sur le plan matériel.

Ce paradoxe n'invalide pas la démarche de Mistral et l'analogie avec ARM est éclairante.

En 2010, ARM ressemblait trait pour trait au Mistral d'aujourd'hui : entreprise nationale, quelques actionnaires étrangers minoritaires, promesses d'indépendance.

Ni l'entreprise, ni les investisseurs, ni le gouvernement britannique n'ont identifié le point de bascule avant qu'il ne soit trop tard : ARM a été vendu à SoftBank en 2016.

Mistral semble avoir tiré la leçon, avec sa golden share.

Mais la question reste ouverte : la souveraineté capitalistique sera-t-elle maintenue quand la valorisation de l'entreprise rendra les offres de rachat inévitables ?

La dépendance matérielle : le talon d'Achille invisible

Il est une dimension de la souveraineté IA dont on parle peu dans les débats politiques sur le "cloud souverain", mais qui conditionne tout le reste : la dépendance aux GPU.

Nvidia détient 95 % du marché des processeurs graphiques utilisés pour l'entraînement et l'inférence des modèles d'IA.

Ses puces sont conçues aux États-Unis et fabriquées par TSMC, société taïwanaise.

L'Europe ne dispose d'aucun équivalent dans cette chaîne de valeur, à l'exception notable d'ASML, le fabricant néerlandais des machines de lithographie sans lesquelles TSMC ne pourrait pas produire les puces de Nvidia.

Cette dépendance n'est pas abstraite.

Les restrictions d'export américaines sur les GPU Nvidia vers la Chine ont démontré que l'accès aux puces IA est devenu un levier géopolitique actionnable.

Huawei a développé ses propres puces Ascend en réponse, et ses superclusters étaient présentés au MWC 2026 comme des alternatives compétitives.

L'Europe, elle, n'a pas encore engagé de réponse industrielle équivalente.

En France, les 109 milliards d'euros d'investissements en data centers IA annoncés par Emmanuel Macron en février 2025 lors du Sommet pour l'IA de Paris visent en partie à réduire cette dépendance.

Mistral AI elle-même a bouclé 830 millions de dollars en mars 2026 pour financer son datacenter à Bruyères-le-Châtel (44 MW de capacité opérationnelle d'ici fin juin 2026).

Un investissement colossal, mais qui reste tributaire de Nvidia.

T-Systems, de son côté, a annoncé en octobre 2025 l'acquisition de 10 000 GPU Nvidia pour construire un cloud IA européen souverain hébergé en Allemagne.

Même logique, même dépendance.

Le paradoxe est fou : pour construire une IA souveraine européenne, il faut acheter des puces américaines, fabriquées à Taïwan, sur des machines néerlandaises.

La souveraineté technologique, dans sa dimension matérielle, reste encore un horizon lointain.

Les voies de sortie : un panorama des solutions disponibles

Face à ce tableau qui peut paraître sombre, plusieurs approches permettent de construire une forme de "souveraineté IA" graduée, adaptée au profil de risque de l'organisation.

Voie 1 : Les modèles open source auto-hébergés.

Mistral (Mixtral, Mistral Large), Meta (Llama 4), et d'autres modèles sous licence ouverte peuvent être téléchargés et déployés sur une infrastructure maîtrisée.

Cette approche offre une souveraineté maximale sur les données d'entrée et d'inférence — aucune donnée ne quitte l'infrastructure de l'organisation.

Le coût est en revanche significatif : infrastructure GPU, équipes techniques, maintenance.

Les Small Language Models (SLM) émergent comme une réponse partielle à ce problème, consommant jusqu'à 80 % d'énergie en moins que les grands modèles, et pouvant être hébergés localement.

Voie 2 : Le "Model-as-a-Service" sur infrastructure souveraine.

Des acteurs comme Scaleway, OVHcloud ou S3NS proposent des services d'inférence basés sur des modèles open source (Mistral, Llama) hébergés sur une infrastructure européenne.

Les données restent en Europe, sous juridiction européenne, sans transiter par des serveurs américains.

C'est l'approche privilégiée pour les organisations qui veulent accéder à des modèles performants sans gérer l'infrastructure elles-mêmes.

Voie 3 : Les API souveraines des acteurs européens.

Mistral AI propose ses modèles via une API dont les données sont hébergées exclusivement via Scaleway et OVHcloud, sans transiter par des serveurs américains.

Pour les organisations dont les exigences de souveraineté sont réelles mais pas maximales, c'est un point d'entrée accessible.

Voie 4 : Les modèles commerciaux américains avec garanties contractuelles.

OpenAI Enterprise, Anthropic for Business et Google Vertex AI proposent des options d'opt-out sur l'utilisation des données pour l'entraînement, et des garanties de résidence des données.

Ces garanties sont réelles sur le plan opérationnel — mais elles ne résolvent pas l'exposition au CLOUD Act et au FISA, comme nous l'avons vu dans les articles précédents de cette série.

✏️ Le "Context Engineering" : la souveraineté se joue dans la donnée, pas dans le modèle

À mesure que les modèles de langage se standardisent et deviennent une commodité, leurs performances convergent rapidement, l'écart entre les meilleurs modèles américains et les meilleurs modèles open source se réduit à quelques points sur les benchmarks, la valeur se déplace vers la donnée.

C'est ce que le livre blanc SFEIR/PAC exprime avec la notion de "Context Engineering" : la capacité à assembler la donnée propriétaire de l'organisation pour l'offrir à l'IA comme carburant unique, produisant des résultats qui le seront aussi.

Une organisation qui maîtrise sa donnée — structurée, nettoyée, enrichie, bien gouvernée — peut obtenir des résultats supérieurs avec un modèle moyen, par rapport à une organisation dont la donnée est éparpillée et mal gouvernée utilisant le meilleur modèle du marché.

La conséquence opérationnelle est directe : investir dans la qualité et la gouvernance de ses données internes (bases de connaissance, documents structurés, historiques de décision) est probablement un investissement en souveraineté plus pérenne qu'investir dans l'accès au dernier modèle en date.

Ce serait la réponse au discours parfois décourageant sur le retard européen dans l'IA : une PME française dont les données propriétaires sont bien organisées et hébergées de manière souveraine pourrait construire un avantage compétitif réel avec des modèles open source, sans dépendre ni de GPT-5 ni d'un datacenter américain.

L'AI Act : une contrainte ou un avantage compétitif ?

Le règlement européen sur l'intelligence artificielle — l'AI Act — est entré en application progressive depuis 2024, avec ses obligations les plus lourdes applicables aux systèmes à haut risque à partir du 2 août 2026.

Il impose aux développeurs de modèles de fondation (GPAI) des obligations de documentation technique, de conformité des données d'entraînement, de marquage CE et d'enregistrement européen.

Ces obligations représentent un coût supplémentaire pour des acteurs comme Mistral AI — qui y sont soumis au titre de leur qualité de fournisseur de modèle.

Mais elles représentent aussi un avantage structurel pour les acteurs européens dans les marchés réglementés : un client soumis au RGPD, à la directive NIS2 ou au secteur financier a une obligation de due diligence sur ses outils IA que les modèles américains ne peuvent pas satisfaire aussi directement qu'un acteur nativement conforme à l'AI Act.

Arthur Mensch, CEO de Mistral AI, ne mâche pas ses mots sur le sujet dans le livre blanc des 22 mesures qu'il a soumis en 2026 : "L'Europe fait face à un écart technologique croissant qui rend ses citoyens, entreprises et gouvernements de plus en plus dépendants d'une domination étrangère."

Ses 22 mesures s'organisent autour de quatre priorités :

- adoption à grande échelle des solutions IA européennes,

- attractivité des talents (dont une "AI Blue Card" pour les chercheurs étrangers),

- passage à l'échelle via un cadre financier adapté,

- renforcement de l'accès aux données et à la puissance de calcul.

L'initiative EuroLLM mérite également d'être mentionnée : ce projet académique et industriel vise à développer un modèle de langage couvrant les 24 langues officielles de l'UE, entraîné sur MareNostrum 5 et avec un entraînement multimodal prévu sur le supercalculateur Jupiter en 2026.

C'est un signal que la réponse européenne n'est pas seulement commerciale, elle est aussi académique et institutionnelle.

Ce que cela signifie concrètement pour les organisations

La souveraineté dans l'IA générative est un sujet qui mérite d'être traité avec la même rigueur que la souveraineté dans le cloud, et avec la même grille de lecture par niveau de criticité des données.

Trois questions permettent de structurer une politique d'usage de l'IA générative souveraine.

1. Quelles données transitent par quels modèles ?

Un audit honnête des usages IA au sein de l'organisation révèle souvent que des données bien plus sensibles que prévu sont soumises à des services d'IA grand public.

L'utilisation de ChatGPT pour résumer un dossier juridique, de GitHub Copilot sur un code propriétaire, ou d'un assistant IA pour analyser des données financières avant une opération stratégique : tous ces usages exposent des données potentiellement stratégiques à des infrastructures américaines.

2. Vos fournisseurs IA utilisent-ils vos données pour entraîner leurs modèles ?

La réponse dépend des contrats signés.

Les offres enterprise des grands acteurs américains proposent généralement un opt-out explicite — mais il faut le demander, le vérifier et l'auditer.

Pour les offres grand public et les accès via API sans conditions spécifiques, la vigilance s'impose.

3. Disposez-vous d'une alternative souveraine pour vos usages les plus critiques ?

La réponse, en 2026, est de plus en plus souvent oui.

Mistral Large 3, Llama 4, les offres MaaS de Scaleway et OVHcloud, et la plateforme Mistral Forge pour l'entraînement de modèles sur mesure constituent un écosystème crédible pour couvrir la majorité des usages professionnels courants dans un environnement souverain.

📌 En conclusion

L'IA générative est devenu le nouveau vecteur d'exposition involontaire des données stratégiques des organisations, souvent plus difficile à contrôler que le cloud, car il passe par des usages quotidiens et individuels, hors du radar des DSI et des RSSI.

La souveraineté dans l'IA se joue sur quatre niveaux :

- données d'entrée,

- données d'entraînement,

- modèle lui-même,

- infrastructure d'inférence.

La localisation du datacenter ne suffit pas : la juridiction du prestataire, les conditions contractuelles d'utilisation des données et la chaîne de contrôle des GPU sont des dimensions tout aussi critiques.

L'Europe dispose désormais d'alternatives crédibles : modèles open source (Mistral, Llama), MaaS sur infrastructure souveraine (OVHcloud, Scaleway, S3NS), offres d'entraînement souverain (Mistral Forge).

La dépendance aux GPU Nvidia reste le talon d'Achille structurel de la souveraineté IA européenne et le seul point sur lequel aucune solution souveraine n'est encore disponible à l'échelle industrielle.

Références

- Silicon.fr, Les Benchmarks de l'IT 2026 — plateformes d'IA générative, 2026

- RedArrow, Mistral AI : 22 mesures pour la souveraineté IA européenne, avril 2026

- Luxsure, L'Europe ne perd pas l'IA dans les modèles. Elle la perd dans la commande publique, février 2026

- Datasolution.fr, Souveraineté numérique et IA : enjeux, Health Data Hub et Mistral, février 2026

- L'Essentiel de l'Éco, Mistral AI : 2026, l'année de tous les dangers, février 2026 —

- Journal du Net, 2026 : l'année où l'IA oblige l'Europe à se structurer, février 2026

- Lonestone.io, Comparatif LLM 2026 : quel modèle choisir pour votre SaaS ?

- IREDIC, Mistral AI au service de la Défense, février 2026

- tech-insider.org, Mistral AI Forge : 5 atouts et tarifs 2026, mars 2026

- Blog-IA.com, Nvidia en 2026 : le géant qui fait tourner toute l'IA mondiale, mars 2026

- LeMagIT, Puces pour l'IA : la production menace de ne pas suivre la demande, février 2025

- LeMagIT, IA souveraine : T-Systems achète 10 000 GPU à Nvidia, octobre 2025

- RoboActu, MWC 2026 : Huawei déploie ses superclusters IA, mars 2026

- WeLoveDevs, Nvidia x Mistral : la collaboration attendue, juin 2025

- ia4business.info, Mistral investit 830 millions dans un data center souverain, 2026

- Dixie Consulting, Mistral AI : Paris devient le hub européen de l'IA en 2026, janvier 2026

- AdevWeb, AI Act : guide de mise en conformité pour les entreprises en 2026, avril 2026

- Blog.mbadmb.com, Analyse du Sommet pour l'Action sur l'IA — Paris, 2025

- SFEIR / PAC, "De la souveraineté forteresse à la résilience", livre blanc, 2026.

- SFEIR.dev, Quel modèle d'IA choisir ?, septembre 2025